Googleは2026年5月、PC版Chromeブラウザに引き続き、Android版ChromeブラウザにGeminiをネイティブ統合するアップデートを発表しました。

この更新により、ブラウザは従来の「閲覧ツール」という枠組みを超え、

ユーザーの意図を解釈して実行する「パーソナル・エージェント」へと移行します。

米国では6月下旬より、Android 12以上かつRAM 4GB以上のデバイスを対象に順次ロールアウトが予定されています。

本記事では、その主要機能と実務的な影響について解説します。

PC版ChromeのGemini in Chromeについてはこちら。

ブラウジングを効率化する主要な4機能

今回の統合における核心は、AIがブラウザの各プロセスに深く介入することにあります。

1. 自動ブラウジング(Auto Browse)

GeminiがWebページ内の情報を瞬時にスキャンし、構造を解析します。

膨大な記事やドキュメントから必要な情報を抽出、要約するだけでなく、複数のタブを跨いだ情報の統合も可能となります。

リサーチ業務において、情報の取捨選択に要していた時間が大幅に圧縮されることは間違いありません。

2. アシスタントによるタスク代行

ブラウザ上での「操作」そのものをGeminiが引き受けます。

例えば、予約サイトでのフォーム入力や、条件に合致する駐車場の確保といった手続きが、自然言語による指示のみで完結します。

手動によるクリックや入力を前提とした従来のUI利用のあり方が、抜本的に見直されることになります。

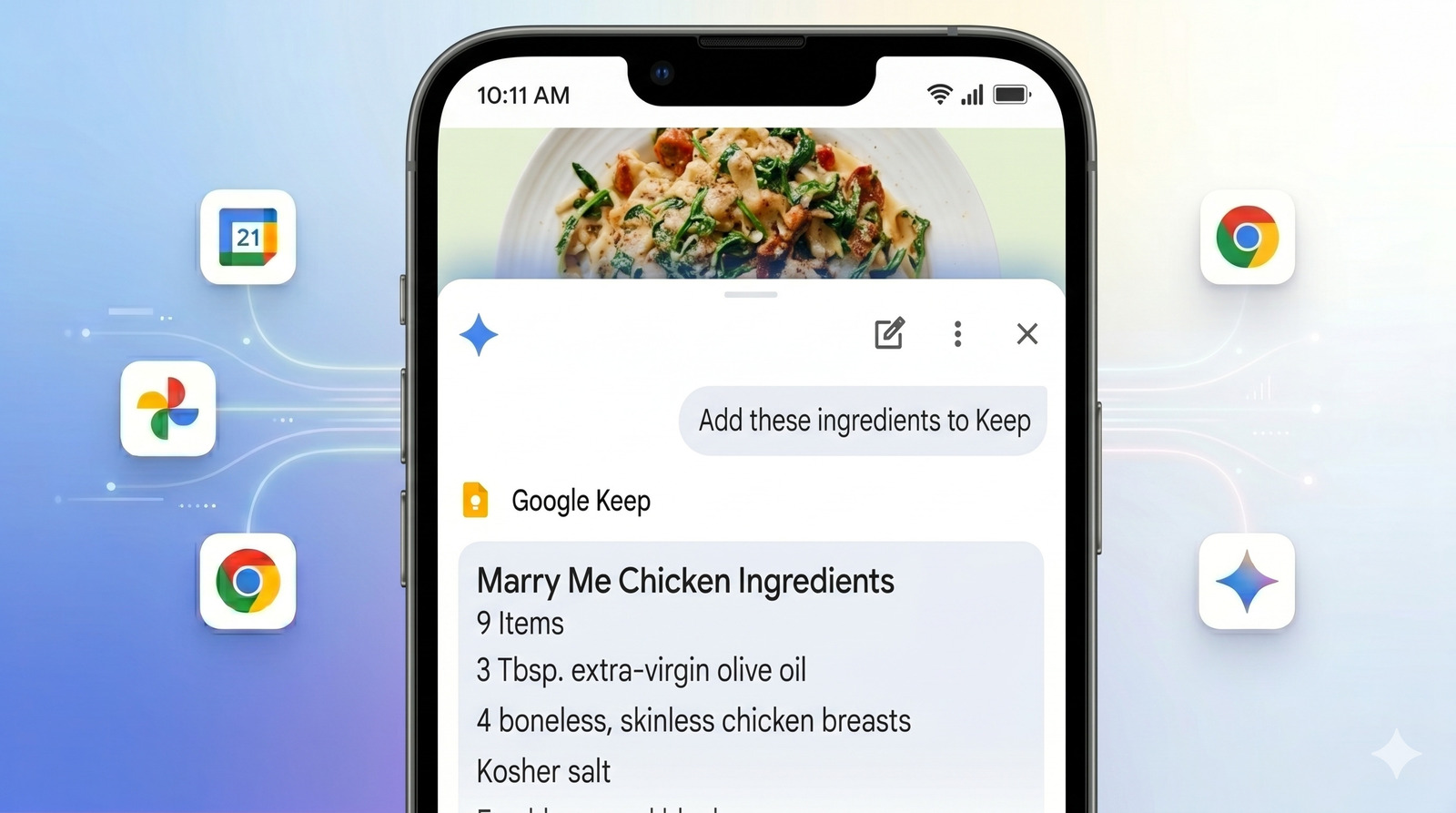

3. Googleエコシステムとの同期

Chromeで見つけた情報を、Workspaceやフォトなどの他のGoogleアプリへ即座に反映します。

イベント情報のカレンダー登録や、特定条件に合致する画像の自動呼び出しなど、アプリ間の境界を意識させないフローが構築されます。

さらにオプトイン機能の「Personal Intelligence」を利用すれば、個人の趣味や関心事に基づいたパーソナライズも可能になります。

4. 画像の生成とカスタマイズ(Nano Banana)

新ツール「Nano Banana」により、Webブラウジング中に直接画像を生成・編集できるようになります。

例えば、テキスト主体のページを視覚的なインフォグラフィックに変換したり、物件の空き部屋画像に家具を配置してシミュレーションするといった、直感的なビジュアル操作がChrome上で完結します。

コンテンツ提供側に求められる構造的変化

機能の進化は、情報の受け取り方だけでなく、送り手側の論理にも大きな変化を迫ります。

「自動ブラウジング」が普及すれば、ユーザーが直接サイトの視覚的要素(GUI)に触れる機会は減少します。

AIが情報を要約して提示するため、細部まで作り込まれたグラフィックや複雑な回遊動線は、AIというフィルターによって削ぎ落とされる可能性があります。

ここでは情報の「アクセシビリティ」の定義が書き換わります。

視覚的な美しさよりも、AIが誤解なく情報を抽出できる「論理的な構造化」が最優先課題となります。

コンテンツの核となる価値を情報の最前面に配置し、AIに正しく解釈させるための情報設計ができているか。

作り手には、これまで以上にシビアな優先順位付けが求められます。

結論として見据えるべき視点

情報の「消費」は、Geminiというエージェントを介した「目的の完結」へと集約されていきます。

ブラウザが個人データと密接に連携し、行動を代行する以上、セキュリティやプライバシーへの配慮は避けて通れません。

Googleはプロンプトインジェクションからの保護や、購入など機密性の高いタスク実行前の「ユーザー確認プロセス」を組み込んでいます。

また、強力な自動ブラウジング(Auto Browse)機能は、AI ProおよびUltraサブスクリプションユーザー向けに限定されるなど、高度なエージェントの利用には要件が設定されています。

提供される情報の正確性がエージェントの動作を左右するため、発信情報の信頼性担保は、もはやマナーではなく技術的な必須要件となります。

この変化は、単なるツールの更新ではありません。

Webというプラットフォームのルールそのものが、人間向けから「AIと人間の共存」向けへと再定義されたと捉えるべきです。